De AI Act (Verordering (EU) 2024/1689) is een mijlpaal in de Europese regelgeving: het is ’s werelds eerste uitgebreide kader voor artificiële intelligentie en trad op 1 augustus 2024 in werking. Deze nieuwe wetgeving heeft enorme implicaties — niet alleen voor tech-bedrijven, maar voor álle ondernemingen en overheidsdiensten die AI gebruiken, ontwikkelen of beheren.

Wat is de AI Act?

De AI Act is een EU-verordening die:

- een gemeenschappelijk wettelijk kader vastlegt voor AI-systemen;

- innovatieve en veilige AI bevordert;

- risico’s voor fundamentele rechten, veiligheid en transparantie adresseert.

Hiermee reguleert Europa het gebruik van AI systemen binnen de EU.

Risicogebaseerde aanpak

De wet classificeert AI-systemen op basis van risico:

- Onaanvaardbaar risico (Verboden): AI die de veiligheid of grondrechten schendt. Voorbeelden: social scoring, gedragsmanipulatie en biometrische surveillance.

- Hoog risico (Strikt gereguleerd): AI die gebruikt word in processen met grote maatschappelijke of individuele impact. Moet voldoen aan strenge eisen voor veiligheid, datakwaliteit en menselijk toezicht. Voorbeelden: HR-selectie, rechtshandhaving, gezondheidszorg en vitale infrastructuur.

- Beperkt risico (Transparantieplicht): AI waarbij de gebruiker moet weten dat er contact is met een machine. Voorbeelden: chatbots en deepfakes.

- Minimaal risico (Vrijgesteld): Alle overige AI zonder specifieke regels vanuit de AI Act. Voorbeelden: spamfilters en AI in videogames

Deze aanpak betekent dat organisaties:

- moeten analyseren en registeren welke AI-toepassingen ze gebruiken;

- risico’s inventariseren;

- compliance-processen inbouwen;

- rapporteren waar nodig.

Waarom dit relevant is

- Compliance is geen optie maar een must: niet-naleving kan leiden tot zware boetes, vergelijkbaar met die onder GDPR.

- AI-risicobeheer wordt een kerncompetentie: bedrijven moeten processen, governance en technische audits opzetten.

- AI kan een strategisch voordeel worden: wie de regels begrijpt en toepast, kan innovatie benutten zonder juridische risico’s.

- Transparantie en ethiek zijn concurrentiefactoren: klanten en partners hechten meer waarde aan verantwoorde AI.

- Samenwerking met de overheid biedt kansen: beleidsmakers zoeken partners om veilige AI-ecosystemen op te bouwen.

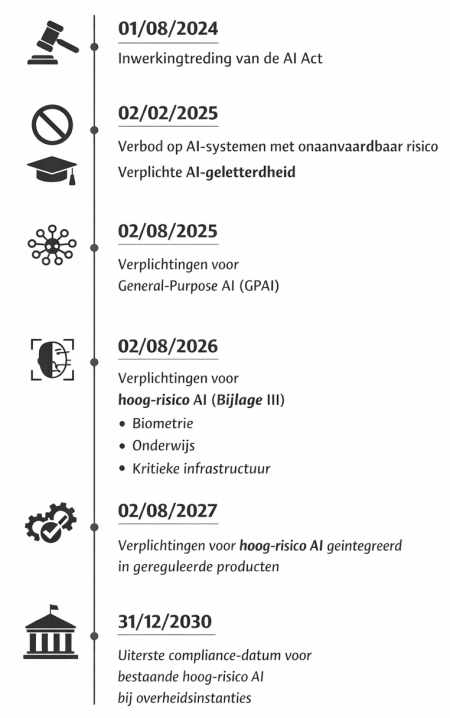

Belangrijke Mijlpalen

Belangrijke opmerking

De Europese Commissie heeft op 19-Nov-2025 het ‘Digital Omnibus on AI’ voorstel. Het voorstel omvat een aantal belangrijke veranderingen aan de EU AI Act.

- Hoog-risico AI vereisten uitgesteld tot 02-Dec-2027 (i.p.v. 02-Aug-2026)

- Hoog-risico AI in gereguleerde producten uitgesteld tot 02-Aug-2028 (i.p.v. 02-Aug-2027)

- Generatieve AI systemen van voor 02-Aug-2026 hebben tot 02-Feb-2027 tijd om de transparency verplichting na te komen.

- Bestaande Hoog-risico systemen al op de markt (uitgezond overheid) hebben tijd tot Aug-2030 om zich aan te passen

- Andere voorgestelde aanpassingen

- De eis om niet hoog-risico AI systemen te registeren in de EU database vervalt.

- Er kan nu beter gevoelige data gebruikt worden om bias te detecteren en verminderen

Aanbevelingen voor actie

- Begin met het aanleggen van AI registry en daarmee gepaard een AI-risicoanalyse van je organisatie.

- Implementeer governance- en compliance-teams voor AI-toepassingen.

- Investeer in transparantie en documentatie van AI-modellen.

- Betrek juridische en ethische expertise vroeg in het ontwikkelingsproces.

- Volg de ontwikkeling van nationale toezichtstructuren actief op.

- EU AI Act

- Andere interessante links

- Handige EU AI Act Gids door FOD Economie (dank aan Agoria om deze aan te wijzen)

Met onder andere deze infographic door de FOD Economie